Win10 ist kein OS es ist ein Service^^

Das läuft nun schon seit Jahren auf meinem Rechner, der immer online ist, auch beim Musik machen.

Ich habe lediglich die Firewall von Win an, aber stelle da nix ein und nutze seit Jahren kein Antiviruszeuchs.

Dabei bin ich sicherlich kein "Saubermann", hatte aber noch nie Probleme (seit mehr als 30 Jahren nicht!)

Du scheinst einen paranoiden Touch zu haben

MacOS “kann” man nur auf Macs verwenden...

Läuft auf Hackintosh, also PC mit OS X. Aber wusste jetzt nicht, ob du auch noch nen Mac hast.

Richte dir dein Windows vernünftig ein und mach Musik, anstatt dich mit unnützem Kram zu befassen

Kommt darauf, welche Ansprüche man hat. (32 Sampels Puffer IMMER // Außer ich muss)

Paranoid bin ich sicher nicht, hab mir 2 Jahre Win10 angetan, und hatte oft Probleme, dass Sachen nicht mehr funktionierten, i.d.R. kurz vor Win10updates.

Und mit nicht funktionieren meine ich, wenn ich sonst ein Projekt durchgehend mit 32Sampels puffer bearbeiten kann, konnte ich es oft (meist kurz vor win10-Upates) nicht mehr, ja mit 128Sampels gings dann, aber interessiert mich nicht,

die Mühle hat zu liefern wann ich will (also immer außer bei Wartungen) und nicht wann es Redmond genehm ist.

Außerdem ist Ubuntu weit benutzerfreundlicher als Win10, und kann mit Schrottsoundkarten (dank Jack) Sachen die sonst nur mit einer RME-Soundkarte oder so erwarten würde...

Und meinen USB-Soundkarte (RME-ADI2pro) steckt man an, installiert Bitwig stellt, wie überall üblich, den Treiber ein,

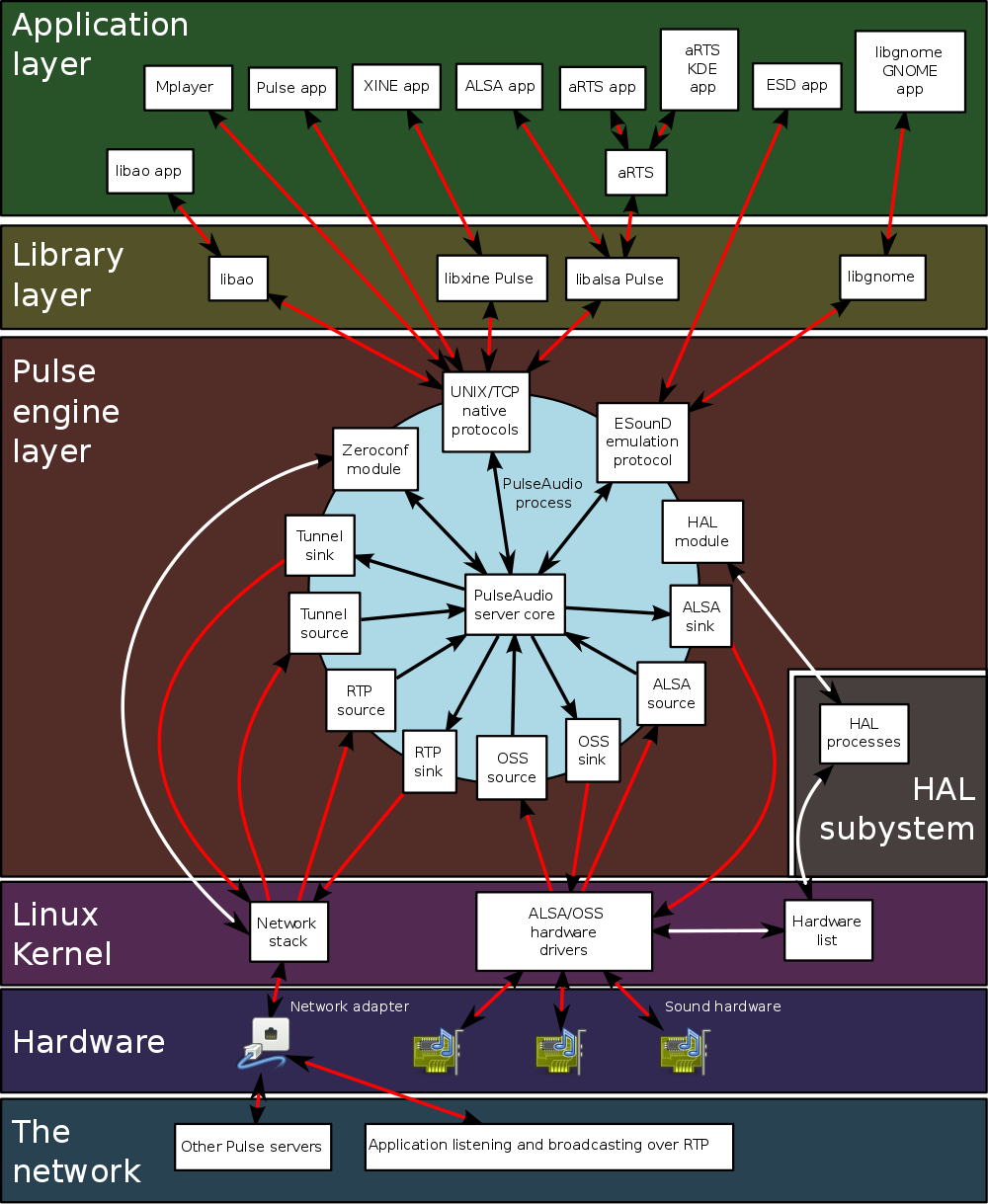

unter Linux ALSA (Bitwig spricht direkt mit Soundkarte) oder

Jack (hat dann Multiclientfähigkeit und RoutingMöglichkeiten), ein.

So schwer ist es nun auch wider nicht. (fast genau gleich wie unter Windows)

(Anmerkung: ich will aber mein RME-MultifaceII als Soundkarte verwenden, und benutze den ADI2pro nur als Wandler e.t.c.)

Ich hab hier Extrawürste, und sogar das scheint relativ einfach umsetzbar zu sein, (wenn man weiß wie's geht).

Seit meiner Win10 zeit hab ich glaub ich min. 5x den RME Treiber neu installieren müssen, und dieses WE sogar den GrafikTreiber neu installieren, e.t.c. ...

(system funktionier einwandfrei, M$ Pfuscht drauf herum > viel Spaß beim wieder herrichten. // nix einfach so schnell Musikmachen)..

Und auf meinen Musik-System muss ich eh Win10 verwenden (weil alten Windowse sich nicht sauber installieren lassen) und meine meiste MusikSoftware leider Win/Mac only ist.

Aber dieses WIn10-System ist ein reines offline System und daher kein Internet.

Und für's Internet starte ich mein Entertainment-System Ubuntu.

Das kriegt Jeder hin, das man damit streamen e.t.c. kann.

Ich will aber gleichzeitig, Bitwig, Fabfilter, uHe am laufen haben, wo der "normale Ton" auch durchgeht und will deshlab:

einen Soundserver, mit hohenPuffer laufen lassen (Pulse Audio),

und einen mit niedrigen Puffer...

Lg