tsss

leute, niemand behauptet nirgendwo, objekt-effekte würden preview automation ersetzen oder "in jeder situation ein allheilmittel" sein.

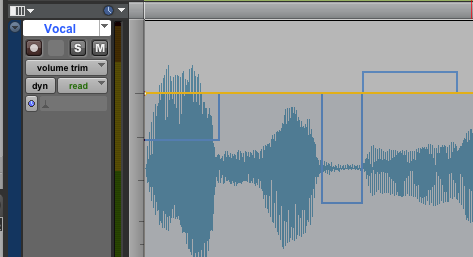

ihr kennt beide clip gain. clip gain ersetzt keinen fader, keine volume automation, und ein allheilmittel ist es auch nicht. aber es ist ein kleines, verdammt praktisches ding, dieses clip gain - nicht mehr und nicht weniger.

und obschon man statt clip gain auch rasend schnell in ganz doll viele objekte einen gain offset destruktiv mit super undohistory reinrechnen könnte, wie man es mit plugins in cubendo machen kann - es ist nicht dasselbe, das weisst du rkdk als nutzer von clip gain doch sicherlich auch. es ist exakt dieselbe diskussion, die man vor einigen jahren mit nutzern hatte, deren daw kein clip gain hatte, da wirst du dir damals doch sicher auch mal gedacht haben "also gut, der logicuser vor mir checkt einfach nicht, dass clip gain einfach ein praktisches toolchen für schnelle handgriffe ist, was aber in der praxis durchaus ne menge unterschied machen kann". heute haben fast alle daws clipgain, und ich denke man lehnt sich nicht besonders weit aus dem fenster mit der behauptung, dass es ein durchaus populäres feature für schnelle handgriffe ist. kein allheilmittel, kein ersatz für nix, sondern wie so vieles einfach eine praktische ergänzung.

da würde ich auch gar keine automation wollen, so wie ich für clip gain auch keine automation wollen würde, sowas würde doch nur die UI zukacken

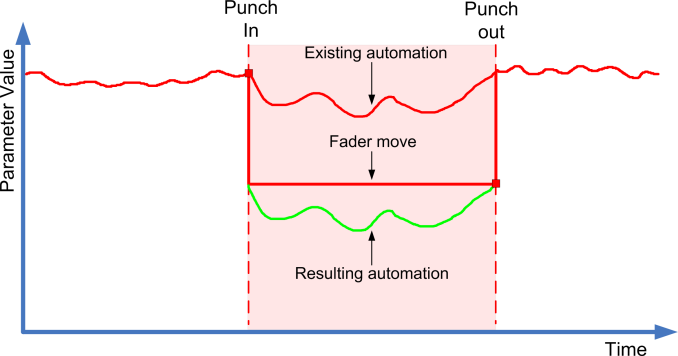

clip gain und objekteffekte sind selber eine form der schnellen mini-automation jenseits der grossen automationsebenen, auch hier passt die analogie haargenau.

zuguterletzt, doch, es gibt sehr wohl produktionsarten, wo ein fast ausschliessliches arbeiten mit objekteffekten ne tolle sache ist. sequoia und samplitude hat man ja nicht ohne grund so oft im radio gesehen. wenn du eine reportage zusammenstellst mit millionen von o-tönen, von denen sich nur der hauptsprecher jemals wiederholt, dann hast du in der klassischen daw im mixer einen albernen kanalsalat mit hunderten kanälen, die alle jeweils nur für ein paar sekunden benutzt werden um hier mal bisschen höhen rein, hier mal bisschen mitten raus...kein mensch braucht das als gerümpel in seinem mixer, da zieht man schon instinktiv tendenziell in den inspector um. mit objektbasiertem mix machst du diese simplen basisangleichungen einfach objektbasiert, und danach machst du im traditionellen mixer schön übersichtlich nochmal das grosse ganze. und trotzdem sind alle plugins nondestruktiv, und du kannst 437246987364983644 stück davon öffnen weil sie jeweils nur dort CPU brauchen, wo das objekt liegt. und wenn du das objekt schiebst musst du nicht kucken ob die automation grad gelockt ist oder nicht, kein voriges eq-setting resetten, danach keinen bereich zuweisen, nix nada. du hast einfach n plugin auf dem objekt, schöne intuitive sache. und wenn du nochmal was reinrechnen willst, kannst du das vollkommen separat von objektplugins tun, die einfach nondestruktiv mitlaufen, und wenn du auf die objekte 137-37652 irgendein plugin packst, musst du das nicht "erst kurz reinrechnen", was zwar nach einer nur kleinen unpässlichkeit klingt, aber spätestens bei der ersten änderung nervt wenn du das aus denselben 734423 objekten "erst kurz rausrechnen" musst um dann ein anderes setting "kurz reinzurechnen". mal ganz zu schweigen davon, dass offline und im-kontext-hören UI-mässig ziemlich natürliche feinde sind.

es ist halt einfach praktisch. wie clipgain bisweilen sogar sehr praktisch. und als jemand, der hier gerade echt keinen dawkrieg führt (meine beiden lieblingsdaws haben das feature selber nicht), versteh ich auch die haltung nicht, sich dagegen zu sträuben, einen solchen praktischen kleinen helfermechanismus in die eigene daw verbaut zu bekommen.

aber man muss ja nicht alles verstehen

na, eben. Ein paar Events vereinzelt mal mit Hall, EQ, Delay, ggf. Mod versehen, sehe ich noch ein. Aber sonst. Naja... Jeder wie er mag, klar, brauchen wir jetzt nicht drüber streiten.

na, eben. Ein paar Events vereinzelt mal mit Hall, EQ, Delay, ggf. Mod versehen, sehe ich noch ein. Aber sonst. Naja... Jeder wie er mag, klar, brauchen wir jetzt nicht drüber streiten.