Rajmund

- Registriert

- 18.06.08

- Beiträge

- 884

- Reaktionen

- 703

- Punkte

- 3.031

Hallo,

vor einiger Zeit wurde auf einer anderen Plattform mal das Thema 3:1-Regel diskutiert: Nehmen zwei oder mehr Mikrofone dasselbe Signal auf, sollten die weiter entfernten Mikros mindestens 3x soweit von der Quelle entfernt sein wie das der Quelle am nächsten stehende, um Kammfiltereffekte zu vermeiden und ggf. Bleeding zu reduzieren. Die Frage bei der Diskussionsrunde war, inwiefern das wirklich praxisrelevant ist und schließlich berücksichtigt die Regel ja etliche Details nicht.

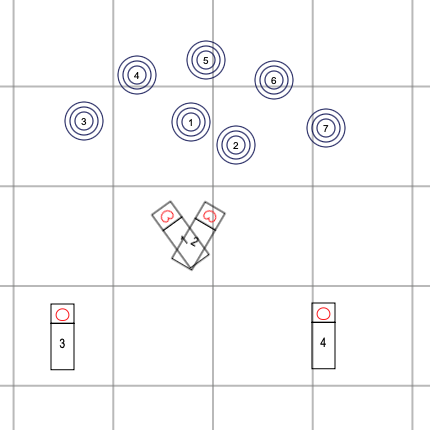

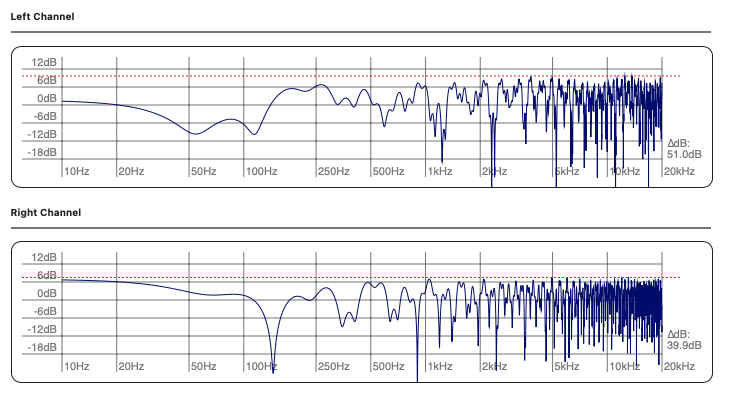

Ich wollte die Sache mal ausführlicher unter die Lupe nehmen und habe eine Web-App programmiert, die das berechnen und auralisieren kann. Letztlich ist daraus eine Simulation geworden, bei der man Schallquellen und Mikrofone frei auf einer virtuellen Bühne platzieren und sich das Ergebnis anhören kann. Zusätzlich wird für jede Schallquelle analysiert, welche Frequenzgangverzerrungen durch die Mikrofonierung entstehen können. Man kann den Simulator also auch dafür verwenden, verschiedene Stereo-Techniken und die Wirkung von Spotmikros auszuprobieren.

Neben bereits vorhandenen Testtönen kann man auch eigene Audiodateien auf die Schallquellen ziehen und so bspw. aus vorhandenen Einzelaufnahmen eines Kammerorchesters eine Mischung kreieren, die sich aus Aufstellung der Instrumente und Mikros ergibt.

Wichtig zu erwähnen ist vielleicht noch, dass die Ergebnisse nicht das Resultat von a-priori-Wissen sind, sondern aus den physikalischen Berechnungen herrühren.

Selbstverständlich hat eine solche Simulation ihre Grenzen: So ist es eine Freifeldsimulation, d.h., für die Raumakustik wird ein ideal trockener Raum angenommen. Individuelle Klangfärbungen von Mikros bleiben unberücksichtigt und ebenso, dass Schallquellen nicht unbedingt Punktquellen sind und in unterschiedlichen Richtungen unterschiedlich abstrahlen. Das macht den Rechner aber nicht nutzlos. Schon allein die klanglichen Unterschiede zwischen XY, Blumlein, AB und Co. sind deutlich wahrnehmbar.

www.stefan-kiessling.de/virtualstage

Letztlich ist immer wieder erstaunlich, was für einen grandiosen Soundprozessor wir als Menschen eingebaut bekommen haben: Bei realen Sounds sind die Klangverfärbungen wesentlich weniger störend als bei Testtönen wie z.B. Rauschen. Das Gehirn korrigiert das anhand der gemachten Erfahrungen.

vor einiger Zeit wurde auf einer anderen Plattform mal das Thema 3:1-Regel diskutiert: Nehmen zwei oder mehr Mikrofone dasselbe Signal auf, sollten die weiter entfernten Mikros mindestens 3x soweit von der Quelle entfernt sein wie das der Quelle am nächsten stehende, um Kammfiltereffekte zu vermeiden und ggf. Bleeding zu reduzieren. Die Frage bei der Diskussionsrunde war, inwiefern das wirklich praxisrelevant ist und schließlich berücksichtigt die Regel ja etliche Details nicht.

Ich wollte die Sache mal ausführlicher unter die Lupe nehmen und habe eine Web-App programmiert, die das berechnen und auralisieren kann. Letztlich ist daraus eine Simulation geworden, bei der man Schallquellen und Mikrofone frei auf einer virtuellen Bühne platzieren und sich das Ergebnis anhören kann. Zusätzlich wird für jede Schallquelle analysiert, welche Frequenzgangverzerrungen durch die Mikrofonierung entstehen können. Man kann den Simulator also auch dafür verwenden, verschiedene Stereo-Techniken und die Wirkung von Spotmikros auszuprobieren.

Neben bereits vorhandenen Testtönen kann man auch eigene Audiodateien auf die Schallquellen ziehen und so bspw. aus vorhandenen Einzelaufnahmen eines Kammerorchesters eine Mischung kreieren, die sich aus Aufstellung der Instrumente und Mikros ergibt.

Wichtig zu erwähnen ist vielleicht noch, dass die Ergebnisse nicht das Resultat von a-priori-Wissen sind, sondern aus den physikalischen Berechnungen herrühren.

Selbstverständlich hat eine solche Simulation ihre Grenzen: So ist es eine Freifeldsimulation, d.h., für die Raumakustik wird ein ideal trockener Raum angenommen. Individuelle Klangfärbungen von Mikros bleiben unberücksichtigt und ebenso, dass Schallquellen nicht unbedingt Punktquellen sind und in unterschiedlichen Richtungen unterschiedlich abstrahlen. Das macht den Rechner aber nicht nutzlos. Schon allein die klanglichen Unterschiede zwischen XY, Blumlein, AB und Co. sind deutlich wahrnehmbar.

www.stefan-kiessling.de/virtualstage

Letztlich ist immer wieder erstaunlich, was für einen grandiosen Soundprozessor wir als Menschen eingebaut bekommen haben: Bei realen Sounds sind die Klangverfärbungen wesentlich weniger störend als bei Testtönen wie z.B. Rauschen. Das Gehirn korrigiert das anhand der gemachten Erfahrungen.

Zuletzt bearbeitet: