Sounddesign mit James Mather; Supervising Soundeditor für Mission Impossible, Wallice & Gromit, Sherlock, Harry Potter

Schon zwei Mal habe ich die FilmSoundHamburg besucht und war begeistert. Bei meinem ersten Besuch leitete James Mather die Masterclass-Sounddesign. Ein Jahr später zog mich Randy Thom in seinen Bann. Die FilmSoundHamburg, jetzt MediaSoundHamburg, wird von der iffm bzw. Hans-Joachim Esser-Mamat organisiert. Als ich las, dass James Mather im Dezember wieder eine Masterclass Sounddesign anbietet, zögerte ich nicht lange und machte mich kurz vor Weihnachten auf den Weg nach München.

James kam zwei Tage vor der Masterclass an und guckte sich erst mal die Innenstadt an. Dabei fielen ihm die Glocken der Frauenkirche auf. Kurzerhand setzte er sich hin, trank ein paar Bier und nahm immer wieder die Glocken auf – mit einem Smartphone. Wer jetzt die Nase rümpft, wird sich noch wundern. Denn auch bei 'Mission: Impossible' wurden Aufnahmen mit dem Smartphone und dem integrierten Mikrofon gemacht. Keine Mikrofon-Aufsätze. Wenige Tage vor Veröffentlichung des Films fiel Tom Cruise auf, dass in der Wassertank-Szene, kurz bevor ihm die Puste ausgeht, gar keine Geräusche von ihm zu hören sind. Also wurden diese noch schnell per Smartphone aufgenommen, mit Filtern für den Unterwasser-Effekt bearbeitet und in die Mischung integriert. Nicht nur die Zuschauer, sondern auch die Crew bekamen bei 'Mission: Impossible' Nervenkitzel, da die Deadline ca. 2 Monate vorgezogen wurde. Wie ist so etwas zu schaffen? In diesem Fall wurde einfach keine Entscheidung mehr in Frage gestellt und viele Experimente gemacht, sondern alles abgearbeitet. Zuerst hatte jeder Editor ein Thema und bearbeitete z.B. nur alles mit Wasser, Motorrädern oder was mit Autos zu tun hatte. Um Langeweile zu vermeiden, wurde das Konzept kurz darauf aber verworfen, so dass jeder Editor alle Soundeffekt für eine komplette Szene kreieren sollte.

Jeder Editor hat aus seiner Library Sounds für den Film zusammengestellt. Alles wurde auf einen Server gepackt und jeder Editor hatte Zugriff auf alles. Früher passte ein Film nicht auf eine Filmrolle. Daher wurde ein Film auf mehreren Filmrollen (Reels) angeliefert, die maximal 20 Minuten lang waren. Nach 20 Minuten musste also Schwarzbild und Stille sein, damit der Schnitt nicht auffällt. Heutzutage ist die Unterteilung technisch nicht mehr notwendig, wird aber oft noch vorgenommen. Die Reels wurden bei 'Mission: Impossible' immer auf externen Festplatten verschickt, damit ProTools nicht relinken musste, da dies zu oft nicht klappte. Backups wurden teilweise intern gemacht.

James Mather erzählte immer wieder Anekdoten. So zum Beispiel von einem Jungen, der auf einem Stock sitzt, der später ein Drache sein soll. Nachdem das Sound-Design fertiggestellt ist, sagt der Regisseur „Das ist nicht, was ich mir vorstelle“. Auf die Frage des Sounddesigners „Können wir den Drachen sehen? Dann wissen wir, wie es klingen muss“ antwortet der Regisseur nur „Nein, aber wenn ich es höre, weiß ich, dass es richtig ist“. James betont, wie wichtig es ist, den Regisseur in den Prozess des Soundeditings einzubeziehen.

Manchmal ist es auch wichtig, einen Job abzugeben (z.B. Dialog Editing), damit das Ergebnis besser wird oder man mehr Schlaf hat. Es nicht immer gut, wenn man alles selber macht. Vielleicht hat man weniger Geld verdient. Das ist aber besser, als Burn-Out zu kriegen oder ein schlechtes Produkt abzuliefern. Oft hört man dieselben Libraries, weil wenig Zeit bleibt. Eine weitere Person könnte z.B. Aufnahmen machen.

Synthesized Sounds nutzt James auch ab und zu. Guns z.B. werden als Sketch oft mit MIDI erstellt. So lassen sich Samples schnell austauschen (z.B. mit Battery, Kontakt etc.). Ableton Live wird auch viel genutzt. Besonders für Atmosphären und Kreaturen.

Manchmal werden aber auch zu viele Effekte erzeugt. Bei 'Mission: Impossible' kaufte man viele Spielzeuge und nahm Sounds für ein Bedienpult auf. Alles, was blinkte, machte ein Geräusch. Am Schluss wollte der Regisseur aber, dass nur ein Knopf An/Aus-Geräusche macht.

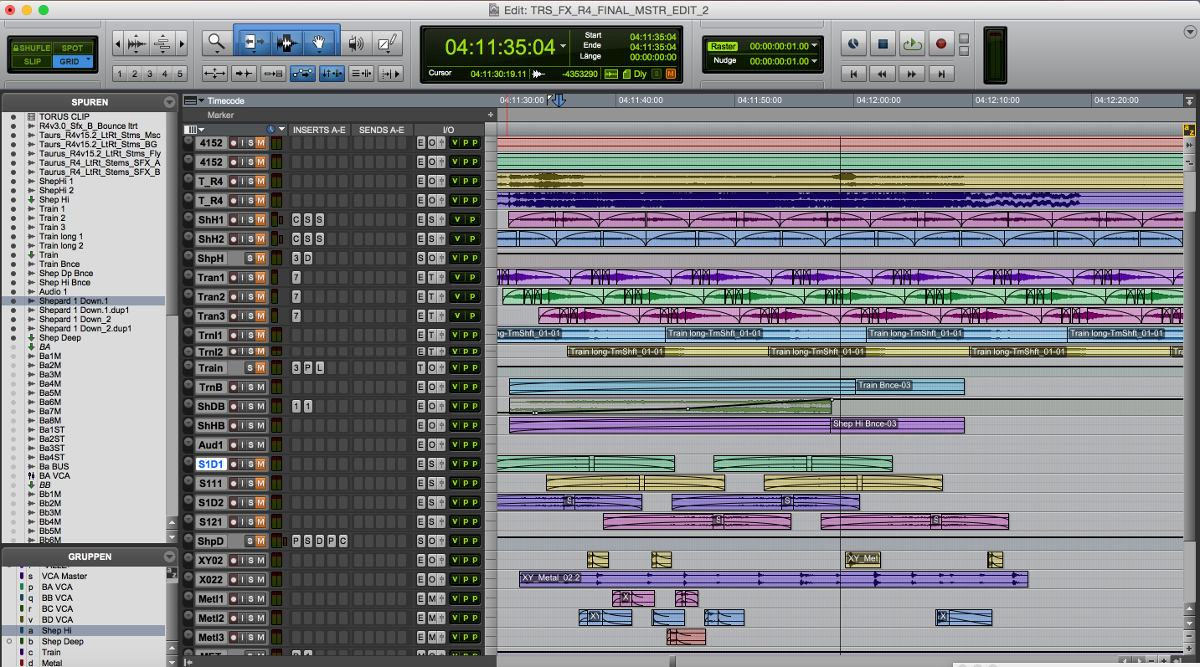

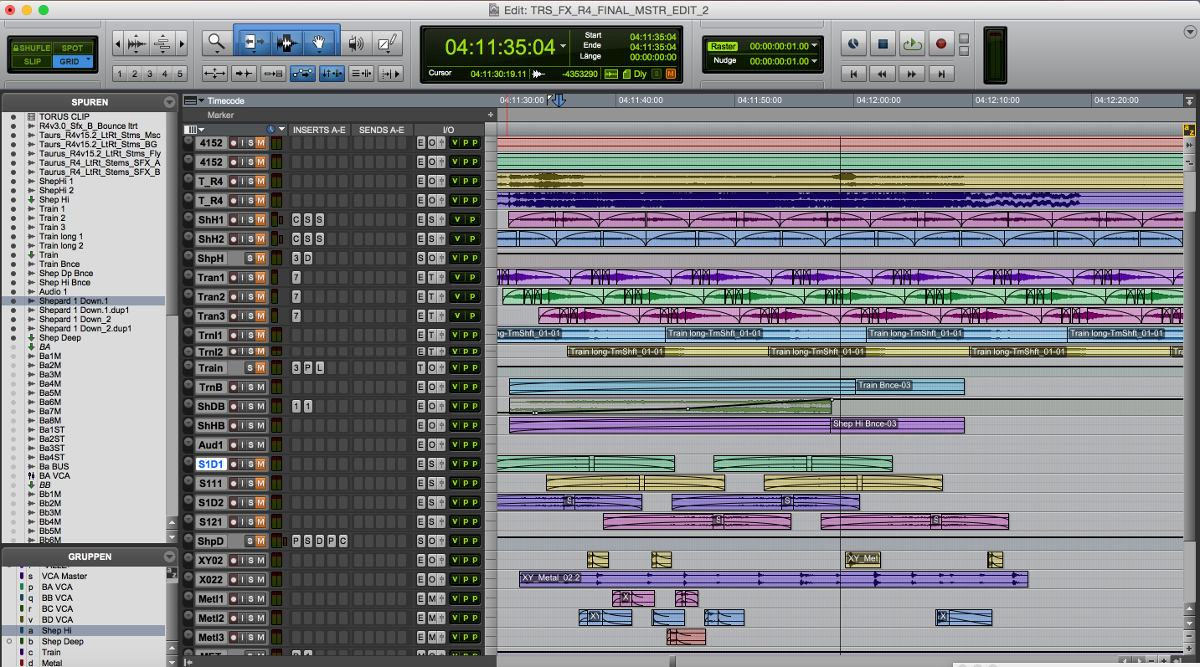

Anhand der 'Mission Impossible'-ProTools-Session zeigte James sein Routing. Die Audio-Files liegen meistens im Mono-Format vor. Ab und zu in Stereo. Es gibt mehrere Gruppen (damit sind keine ProTools-Gruppen oder Aux-Tracks gemeint): z.B. A-F. Dies ist eine Unterteilung bzw. Zusammenfassung mehrerer Spuren. Dafür wird ein Dead-Track (ein leerer Audio-Track) benutzt.

Alle Tracks einer Gruppe werden einem VCA-Fader zugewiesen. Gleichzeitig werden alle Tracks auf einen Aux-Track / Bus / Group-Track geroutet. Auf den ersten Blick mag man sich sicher über den Doppel-Moppel wundern. Der Aux-Track wird benutzt, um alle Signale mit einem Effekt zu bearbeiten (z.B. EQ, Hall) und im Surround-Feld zu pannen. Mit dem VCA-Fader wird die Lautstärke automatisiert. Die Lautstärke einzelner Spuren wird nicht mit dem Fader, sondern Clip-Gain erledigt, da dies beim Re-Edit einer neuen Schnitt-Version für weniger Probleme mit Automationen sorgt.

Der VCA-Fader ist praktisch, da wirklich die Fader bewegt werden und Automation direkt in die Spuren übertragen werden kann. Ein weiterer Vorteil: Beim Ausspielen der Einzel-Spuren, haben diese auch direkt die richtige Lautstärke und nicht erst hinter dem Bus.

Als Surround-Reverb nutzt James unter anderem den Phoenix Verb in der Surround-Version von Exponential Audio.

Oft kommen vom Cutter neue Schnitt-Versionen. EDLs können da helfen und mit Virtual Katy oder Nuendos Re-Conform eine neue Version des Projektes erstellt werden. Dabei müssen PlugIns, Reverb-Automation, Lautstärken etc. angepasst werden. Da James aber nicht viele Re-Edits machen möchte und dafür bei 'Mission Impossible' auch keine Zeit hatte, wollte er gar nicht jeden neuen Schnitt bekommen, da EDLs oft nicht viel helfen und Änderungen per Hand gemacht werden.

https://www.youtube.com/embed/JU34aBQ8xFI Mittlerweile wird dem Re-Recording-Mixer oft die komplette Session übergeben, die mit „Import Session Data“ importiert werden. So bedeutet die Arbeit mit Stems manchmal mehr Arbeit beim Re-Recording, da nur editiert werden kann, indem Stems mühevoll auseinandergeschnitten und Lücken gefüllt werden müssen. In den USA dagegen wird immer noch gerne mit Stems gearbeitet.

Der Final-Mix von 'Mission: Impossible' dauerte 3 Woche, hätte vor 5 Jahren aber noch 7 Wochen benötigt. In England ist das Sound-Design günstiger als in den USA. Daher wird viel Ton in London gemacht. Was auch daran liegt, dass es in Großbritannien immer noch keine Gewerkschaft für den Ton gibt.

Nicht immer klappt der Temp-Mix einer Szene, da er im Kontext auf einmal zu groß ist. Eine Szene für sich kann in sich schlüssig klingen. Doch später stellt sich heraus, dass man die Hälfte der Spuren muten kann. So durften wir bei 'Mission Impossible' viele gemutete Clips hören und erfuhren, warum diese Sounds nicht benutzt wurden.

Bei 'Mission Impossible' zerstören Ethan Hunt und seine Komplizin eine Dach-Scheibe, die in viele Einzelteile zerfällt. Da das Sounddesign schon vor den VFX kreiert wurde, wusste man nicht genau, wie die Sequenz aussieht und damit auch zu klingen hat. Für die kleinen Glasscherben wurde z.B. Sand auf Glas gestreut. Für Unterwasser-Sounds packte James sein Smartphone in einen wasserdichten Beutel und war selber positiv überrascht über das Ergebnis.

Auch wenn beim PreMix viele Effekte schon eingerechnet werden, so bleiben zwei Effekte außen vor: Hall und Kompression / Dynamik. Das Sound-Editing wird in kleineren Räumen gemacht und nur im Misch-Kino können Hall und Dynamik beurteilt werden.

Mittlerweile wird als Ausgabe-Format oft DCP (Digital Cinema Package) benutzt. In diesem Format werden auch Kino-Werbespots abgegeben. Das hat mehrere Vorteile. Es werden diskrete Kanäle bzw. Files (bei 5.1 sind es z.B. 6) abgegeben und kein AC3. Daher findet keine Codierung und somit auch kein Übersprechen der Kanäle statt. Dies ermöglichte bei einigen Filmen kurzfristige Änderungen. Sogar Änderungen nach Veröffentlichung sind per MXF-File möglich. Dies sind die häufigsten Formate:

5.1

7.1

IMAX 12.1

Atmos 9.1

Dolby Atmos ist das neueste Dolby Format. Es gibt Beds und Objects. Beds sind fest auf einer Position. Objects dagegen haben Bewegungen im Raum gespeichert. Der große Vorteil besteht darin, dass die Kinos eine unterschiedliche Anzahl an Lautsprechern haben, und die Position der Objects interpoliert bzw. berechnet und dementsprechend auf die Lautsprecher verteilt wird. Ein neues Format muss sich etablieren und braucht Inhalte. So zahle Dolby anfangs für Atmos-Mixe. Anschließend richtete Dolby sogar kostenlos Atmos Studios ein.

Doch die Chinesen haben ein eigenes Immersive-Soundformat entwickelt. Und da der größte Markt für Film China ist, hat Dolby bei Atmos weniger Kunden, als erwartet. Hinzu kommt, dass die Kunden nur alleine für Dolby Atmos nicht mehr Geld bezahlen. Im UCI gibt es iSense, das Komplett-Premium anbietet: XXL-Leinwand, 'Luxus'-Sitze, 3D und Dolby Atmos. Meiner Erfahrung nach nehme ich den Unterschied zwischen 7.1 und Dolby Atmos bei Action-Sequenzen, in denen es von Sounds nur so wimmelt, sowieso nicht mehr wahr.

Das Spielen mit Mehrkanal-Ton kann eine große Wirkung haben. So kann Mono-Ton im Center klaustrophobisch wirken. Werden dann wieder die Surround-Kanäle genutzt, hat dies eine große Wirkung, Grenzen werden gesprengt. Den Downmix macht James gerne mit Neyrinck SoundCode LtRt Tools.

Oft werden Tiere benutzt, um Sounds eine gewisse Tiefe und Lebendigkeit oder Bedrohung zu verleihen. Bei 'Mission: Impossible' wurde dies aber zum Großteil vermieden und man griff eher auf Vocal-Sounds zurück.

Im Wassertank vermag man eine Turbine oder einen Jet als Original-Sound zu hören. In Wahrheit kamen hier aber Vocals zum Einsatz, die den Shepard-Tone nachbilden. Dies ist ein Effekt, der vermeintlich endlos ansteigt. Die Wirkung wird dadurch erzielt, dass ein Ton z.B. von C3 bis C5 ansteigt. Allerdings gibt es einen Fade-In von C3 bis C4. Aber C4 bis C5 gibt es wieder einen Fade-Out. Während der erste Sound bei C4 ist, startet der nächste (identische) bei C3 mit einem Fade-In. So gibt es also verschiedene Oktaven, die unterschiedlich laut zu hören sind. Randy Thom nutzte diesen Effekt auch, um in dem Film 'Plain' den Absturz des Flugzeuges nicht in der Dramaturgie abreißen zu lassen.

SoundWorks Collection - The Sound of Flight from Michael Coleman on Vimeo.

Als Mikrofone kamen ein Sennheiser MKH416 und ein Kontakt-Mikrofon zum Einsatz. Etwas Reverb macht den Effekt etwas weicher und indirekter. Zusätzliche wurden einige Stimmen eine Oktave tiefer gestimmt.

Wichtig beim Sound-Konzept war, dass das Geräusch nicht durch eine Turbine erzeugt wird, die das Wasser antreibt, sondern dass das Wasser die Turbine bewegt wie in einem Wasser-Stromwerk.

Von der Wassertank-Szene hörten wir uns nur die Foley-Effekte an. Gerade bei dieser Szene fand eine enge Zusammenarbeit zwischen Foley und FX Editors statt. Die Foley Artists kümmerten sich auch um Wasser-Bewegungen und Bewegungen unter Wasser. Daher landeten viele Foley-Aufnahmen später auf FX Gruppen. Zu 20 Prozent wurden Foley-Aufnahmen gemacht, was wenig ist. Die Wassertank-Szene hätte normalerweise sechs Tage gebraucht, wurde aber in nur drei Tagen fertiggestellt. Die Foleys für den kompletten Film wurde in vier Wochen aufgenommen.

Foleys klingen alleine manchmal recht trocken und direkt, halten aber oft Dialog und FX zusammen. Zusätzlich können Foleys einen Rhythmus reparieren. Durch den Bildschnitt, wenn ein Schauspieler von einem in ein anderes Zimmer geht, könnte der Rhythmus der Schritte ungleichmäßig im O-Ton / Production-Sound sein. Dies kann mit Foley gerettet werden.

Ein weiteres Konzept-Beispiel im Sound-Design war der Arm der Turbine, der sich im Kreis dreht und Tom Cruise im späteren Verlauf erwischt und von seinem Vorhaben abhält. Auch wenn dieser Arm sich konstant bewegt, ist er immer nur dann kurz zu hören, wenn er sich sichtbar vorbei bewegt. Wäre er immer hörbar, könnte man sich fragen, warum Ethan Hunt den Arm nicht selber gehört hat, lange bevor er von ihm getroffen wird, und ausweicht.

Wichtig ist auch der Herz-Sound. Dieser hat zwei Zwecke. Zum Einen unterstreicht er die Dramaturgie. Zum Anderen wird der Herzschlag später immer langsamer und leiser, als Ethan Hunt zu ertrinken droht. Das Herz besteht aus zwei Elementen: Einer gefilterten Kick-Drum und einem Sonographie ähnlichen Sound. Zuerst wurde wirklich ein Original-Sound genommen. Dieser war aber nicht überzeugend. Daher wurden mehrere Wooshes gelayert, mit Hall versehen, gefiltert und geloopt.

Um wirklich auf die tiefen Frequenzen gut spüren zu können, bliesen alle Teilnehmer einen Luftballon auf und nahmen ihn in die Hand. So kann man den Ton noch besser wahrnehmen.

Der Tag wurde beschlossen mit der Aufgabe, die Wassertank-Sequenz selber zu vertonen.

Am zweiten Tag ging es in die Natur. Alle Teilnehmer waren bepackt mit Aufnahme-Equipment. Dabei kam wirklich alles zum Einsatz:

- iPhone mit eingebautem Mikrofon

- Rode-Mikro iXY auf iPhone

- Fostex FR2LE

- SoundDevices 552

- SoundDevices 788T

- Neumann M/S System

- Zoom H4

- Zoom H6

- Neumann KMR 82i

- Rode NT4

- Rode NTG3

https://www.youtube.com/embed/9WI0sdNoId8 Der erste Halt war ein altes Wasser-Kraftwerk. Dort gab es viele Wasser-Geräusche, die aufgenommen wurden. Weiter ging es zum Bahnhof. Dort fanden zuerst ankommende und abfahrend Züge ihren Weg auf die SD-Karte. Ein Teil der Crew betrat (teils ohne Ticket) den Zug, um eine Station zu fahren und die Geräusche innen aufzunehmen. Leider hörte man überall Gespräche, Telefone, Telefon-Gespräche, Kinder und Brot-Tüten. Der andere Teil der Crew blieb vor Ort und nahm an einer Baustelle Geräusche auf.

Auf dem Rückweg nutzte man den nassen Asphalt, der besonders schöne Geräusche macht, wenn Autos vorbeifahren.

Zurück im 'Arbeitsraum' nahmen wir unsere Stimmen auf, um den Shepard-Tone nachzubilden. Anschließend teilten wir uns in eine Wasser- und eine Maschine-Gruppe auf (jeweils vier Teilnehmer). Ich war in der Maschine-Gruppe. Mit den Vocal-Aufnahmen und den Zug Geräuschen baute ich den Shepard-Tone. Aus den Vocal-Aufnahmen mussten die besten Stellen gefunden werden. Dazu kam noch, dass Vocal-Einsätze verschleiert oder weichgezeichnet werden mussten, damit der Effekt flüssig wurde. Auch Atmer wurden entfernt. Für das Anfahren der Turbine wurde ein tiefer Vocal-Sound erzeugt. Dafür wurde der bearbeitete Effekte in 96 kHz abgespeichert und in das Projekte ohne Samplerate-Konvertierung eingeladen. Da das Projekt (wie immer bei Film) mit 48 kHz arbeitete, wurde das File halb so schnell wiedergegeben. Dadurch war es doppelt so lang und eine Oktave tiefer.

Da uns netterweise MacBookPros zur Verfügung gestellt wurden, auf denen ProTools installiert war, mussten wir mit den internen PlugIns arbeiten. Die tiefen Vocals wurden mit dem Sans-Amp und dem Sci-Fi Effekt bearbeitet. Etwas mehr Tiefe bekam der Effekt durch einen Raum. Anschließend gab es zwei Filter. Der Lowpass-Filter wurde immer weiter aufgezogen, um den Sound einzublenden. Der Hochpassfilter ließ den Sound am Schluss verschwinden, statt eines simplen Fade Outs.

Der obere Chor wurde ähnlich bearbeitet. Für etwas mehr Bewegung und um den ansteigenden Effekt zu verstärken, nutze ich im PlugIn Sci-Fi den Res+ Modus und fuhr die Frequenz immer höher. Die Sounds wurden leicht im Panorama verteilt. Eine zu starke Verteilung hätte aber die Wirkung des Shepard-Tones zerstört. Daher wurde ein Delay benutzt, was links und rechts leicht unterschiedliche Delay-Zeiten hatte, was den Sound breiter erscheinen lässt.

https://www.youtube.com/embed/p6rxbV-KRkI

Alex kümmerte sich um weitere Maschinen-Sounds. Einige Zug-Aufnahmen wurden für das Anfahren der Maschine benutzt. Mit anderen wurde auch ein Shepard-Tone ähnlicher Effekt erzeugt. Für mehr Obertöne nutzte Alex den PitchShifter und dessen Feedback, das gerade so hoch eingestellt wurde, dass es nicht wehtut.

Bei anderen Aufnahmen wurde ein Waves Denoiser zweckentfremdet und so stark eingestellt, dass er das Signal verfremdet und zu stark eingreift. Dadurch wird der Sound durch entfernte Transienten weichgezeichnet und bekommt sogar einen leichten Unterwasser-Effekt.

Eine andere Quelle ist eine Schuh-Putz-Maschine. Alex drückte mit dem Fuß so fest dagegen, dass die Maschine stoppte. Als er den Druck reduzierte, fing die Maschine wieder langsam an zu laufen und erhöhte das Tempo. Dabei hörte man auch wunderbar, wie der Motor gegen den Druck des Schuhs arbeitet.

Für den Final-Mix fügten beide Gruppen ihre Arbeit zusammen. Im Vergleich mit James' Arbeit stellte sich heraus, dass in seiner Mischung viel weniger Wasser zu hören ist, was am Anfang bei ihm aber auch nicht so war und das Ergebnis eines langen Prozesses war.

Nach drei Tagen stieg ich inspiriert in den Zug nach Hause. James beantwortet wirklich jede Frage, gibt viel Wissen weiter, was man nicht so einfach bekommt und unterhält dabei gleichzeitig. Gleichzeitig lernt man viele nette Leute / Kollegen kennen. Die ganze Zeit über bestand ein reger Austausch zwischen allen Teilnehmern. Jeder, der nicht bei dieser Masterclass dabei war, hat viel verpasst. Die nächste Möglichkeit ist wieder die MediaSoundHamburg.

Die Teilnehmer der Masterclass stellten netterweise einige Aufnahmen zur Verfügung, die ihr runterladen könnt.

Sounds: Library_Masterclass.zip (ca. 900 MB zip)

Vorherige Artikel zur FilmSound Hamburg auf recording.de

James Mather Masterclass-Sounddesign 2012 (Link)

Randy Thom Masterclass-Sounddesign 2013 (Link)

James kam zwei Tage vor der Masterclass an und guckte sich erst mal die Innenstadt an. Dabei fielen ihm die Glocken der Frauenkirche auf. Kurzerhand setzte er sich hin, trank ein paar Bier und nahm immer wieder die Glocken auf – mit einem Smartphone. Wer jetzt die Nase rümpft, wird sich noch wundern. Denn auch bei 'Mission: Impossible' wurden Aufnahmen mit dem Smartphone und dem integrierten Mikrofon gemacht. Keine Mikrofon-Aufsätze. Wenige Tage vor Veröffentlichung des Films fiel Tom Cruise auf, dass in der Wassertank-Szene, kurz bevor ihm die Puste ausgeht, gar keine Geräusche von ihm zu hören sind. Also wurden diese noch schnell per Smartphone aufgenommen, mit Filtern für den Unterwasser-Effekt bearbeitet und in die Mischung integriert. Nicht nur die Zuschauer, sondern auch die Crew bekamen bei 'Mission: Impossible' Nervenkitzel, da die Deadline ca. 2 Monate vorgezogen wurde. Wie ist so etwas zu schaffen? In diesem Fall wurde einfach keine Entscheidung mehr in Frage gestellt und viele Experimente gemacht, sondern alles abgearbeitet. Zuerst hatte jeder Editor ein Thema und bearbeitete z.B. nur alles mit Wasser, Motorrädern oder was mit Autos zu tun hatte. Um Langeweile zu vermeiden, wurde das Konzept kurz darauf aber verworfen, so dass jeder Editor alle Soundeffekt für eine komplette Szene kreieren sollte.

Jeder Editor hat aus seiner Library Sounds für den Film zusammengestellt. Alles wurde auf einen Server gepackt und jeder Editor hatte Zugriff auf alles. Früher passte ein Film nicht auf eine Filmrolle. Daher wurde ein Film auf mehreren Filmrollen (Reels) angeliefert, die maximal 20 Minuten lang waren. Nach 20 Minuten musste also Schwarzbild und Stille sein, damit der Schnitt nicht auffällt. Heutzutage ist die Unterteilung technisch nicht mehr notwendig, wird aber oft noch vorgenommen. Die Reels wurden bei 'Mission: Impossible' immer auf externen Festplatten verschickt, damit ProTools nicht relinken musste, da dies zu oft nicht klappte. Backups wurden teilweise intern gemacht.

James Mather erzählte immer wieder Anekdoten. So zum Beispiel von einem Jungen, der auf einem Stock sitzt, der später ein Drache sein soll. Nachdem das Sound-Design fertiggestellt ist, sagt der Regisseur „Das ist nicht, was ich mir vorstelle“. Auf die Frage des Sounddesigners „Können wir den Drachen sehen? Dann wissen wir, wie es klingen muss“ antwortet der Regisseur nur „Nein, aber wenn ich es höre, weiß ich, dass es richtig ist“. James betont, wie wichtig es ist, den Regisseur in den Prozess des Soundeditings einzubeziehen.

Manchmal ist es auch wichtig, einen Job abzugeben (z.B. Dialog Editing), damit das Ergebnis besser wird oder man mehr Schlaf hat. Es nicht immer gut, wenn man alles selber macht. Vielleicht hat man weniger Geld verdient. Das ist aber besser, als Burn-Out zu kriegen oder ein schlechtes Produkt abzuliefern. Oft hört man dieselben Libraries, weil wenig Zeit bleibt. Eine weitere Person könnte z.B. Aufnahmen machen.

Synthesized Sounds nutzt James auch ab und zu. Guns z.B. werden als Sketch oft mit MIDI erstellt. So lassen sich Samples schnell austauschen (z.B. mit Battery, Kontakt etc.). Ableton Live wird auch viel genutzt. Besonders für Atmosphären und Kreaturen.

Manchmal werden aber auch zu viele Effekte erzeugt. Bei 'Mission: Impossible' kaufte man viele Spielzeuge und nahm Sounds für ein Bedienpult auf. Alles, was blinkte, machte ein Geräusch. Am Schluss wollte der Regisseur aber, dass nur ein Knopf An/Aus-Geräusche macht.

Anhand der 'Mission Impossible'-ProTools-Session zeigte James sein Routing. Die Audio-Files liegen meistens im Mono-Format vor. Ab und zu in Stereo. Es gibt mehrere Gruppen (damit sind keine ProTools-Gruppen oder Aux-Tracks gemeint): z.B. A-F. Dies ist eine Unterteilung bzw. Zusammenfassung mehrerer Spuren. Dafür wird ein Dead-Track (ein leerer Audio-Track) benutzt.

Alle Tracks einer Gruppe werden einem VCA-Fader zugewiesen. Gleichzeitig werden alle Tracks auf einen Aux-Track / Bus / Group-Track geroutet. Auf den ersten Blick mag man sich sicher über den Doppel-Moppel wundern. Der Aux-Track wird benutzt, um alle Signale mit einem Effekt zu bearbeiten (z.B. EQ, Hall) und im Surround-Feld zu pannen. Mit dem VCA-Fader wird die Lautstärke automatisiert. Die Lautstärke einzelner Spuren wird nicht mit dem Fader, sondern Clip-Gain erledigt, da dies beim Re-Edit einer neuen Schnitt-Version für weniger Probleme mit Automationen sorgt.

Der VCA-Fader ist praktisch, da wirklich die Fader bewegt werden und Automation direkt in die Spuren übertragen werden kann. Ein weiterer Vorteil: Beim Ausspielen der Einzel-Spuren, haben diese auch direkt die richtige Lautstärke und nicht erst hinter dem Bus.

Als Surround-Reverb nutzt James unter anderem den Phoenix Verb in der Surround-Version von Exponential Audio.

Oft kommen vom Cutter neue Schnitt-Versionen. EDLs können da helfen und mit Virtual Katy oder Nuendos Re-Conform eine neue Version des Projektes erstellt werden. Dabei müssen PlugIns, Reverb-Automation, Lautstärken etc. angepasst werden. Da James aber nicht viele Re-Edits machen möchte und dafür bei 'Mission Impossible' auch keine Zeit hatte, wollte er gar nicht jeden neuen Schnitt bekommen, da EDLs oft nicht viel helfen und Änderungen per Hand gemacht werden.

https://www.youtube.com/embed/JU34aBQ8xFI Mittlerweile wird dem Re-Recording-Mixer oft die komplette Session übergeben, die mit „Import Session Data“ importiert werden. So bedeutet die Arbeit mit Stems manchmal mehr Arbeit beim Re-Recording, da nur editiert werden kann, indem Stems mühevoll auseinandergeschnitten und Lücken gefüllt werden müssen. In den USA dagegen wird immer noch gerne mit Stems gearbeitet.

Der Final-Mix von 'Mission: Impossible' dauerte 3 Woche, hätte vor 5 Jahren aber noch 7 Wochen benötigt. In England ist das Sound-Design günstiger als in den USA. Daher wird viel Ton in London gemacht. Was auch daran liegt, dass es in Großbritannien immer noch keine Gewerkschaft für den Ton gibt.

Nicht immer klappt der Temp-Mix einer Szene, da er im Kontext auf einmal zu groß ist. Eine Szene für sich kann in sich schlüssig klingen. Doch später stellt sich heraus, dass man die Hälfte der Spuren muten kann. So durften wir bei 'Mission Impossible' viele gemutete Clips hören und erfuhren, warum diese Sounds nicht benutzt wurden.

Bei 'Mission Impossible' zerstören Ethan Hunt und seine Komplizin eine Dach-Scheibe, die in viele Einzelteile zerfällt. Da das Sounddesign schon vor den VFX kreiert wurde, wusste man nicht genau, wie die Sequenz aussieht und damit auch zu klingen hat. Für die kleinen Glasscherben wurde z.B. Sand auf Glas gestreut. Für Unterwasser-Sounds packte James sein Smartphone in einen wasserdichten Beutel und war selber positiv überrascht über das Ergebnis.

Auch wenn beim PreMix viele Effekte schon eingerechnet werden, so bleiben zwei Effekte außen vor: Hall und Kompression / Dynamik. Das Sound-Editing wird in kleineren Räumen gemacht und nur im Misch-Kino können Hall und Dynamik beurteilt werden.

Mittlerweile wird als Ausgabe-Format oft DCP (Digital Cinema Package) benutzt. In diesem Format werden auch Kino-Werbespots abgegeben. Das hat mehrere Vorteile. Es werden diskrete Kanäle bzw. Files (bei 5.1 sind es z.B. 6) abgegeben und kein AC3. Daher findet keine Codierung und somit auch kein Übersprechen der Kanäle statt. Dies ermöglichte bei einigen Filmen kurzfristige Änderungen. Sogar Änderungen nach Veröffentlichung sind per MXF-File möglich. Dies sind die häufigsten Formate:

5.1

7.1

IMAX 12.1

Atmos 9.1

Dolby Atmos ist das neueste Dolby Format. Es gibt Beds und Objects. Beds sind fest auf einer Position. Objects dagegen haben Bewegungen im Raum gespeichert. Der große Vorteil besteht darin, dass die Kinos eine unterschiedliche Anzahl an Lautsprechern haben, und die Position der Objects interpoliert bzw. berechnet und dementsprechend auf die Lautsprecher verteilt wird. Ein neues Format muss sich etablieren und braucht Inhalte. So zahle Dolby anfangs für Atmos-Mixe. Anschließend richtete Dolby sogar kostenlos Atmos Studios ein.

Doch die Chinesen haben ein eigenes Immersive-Soundformat entwickelt. Und da der größte Markt für Film China ist, hat Dolby bei Atmos weniger Kunden, als erwartet. Hinzu kommt, dass die Kunden nur alleine für Dolby Atmos nicht mehr Geld bezahlen. Im UCI gibt es iSense, das Komplett-Premium anbietet: XXL-Leinwand, 'Luxus'-Sitze, 3D und Dolby Atmos. Meiner Erfahrung nach nehme ich den Unterschied zwischen 7.1 und Dolby Atmos bei Action-Sequenzen, in denen es von Sounds nur so wimmelt, sowieso nicht mehr wahr.

Das Spielen mit Mehrkanal-Ton kann eine große Wirkung haben. So kann Mono-Ton im Center klaustrophobisch wirken. Werden dann wieder die Surround-Kanäle genutzt, hat dies eine große Wirkung, Grenzen werden gesprengt. Den Downmix macht James gerne mit Neyrinck SoundCode LtRt Tools.

Oft werden Tiere benutzt, um Sounds eine gewisse Tiefe und Lebendigkeit oder Bedrohung zu verleihen. Bei 'Mission: Impossible' wurde dies aber zum Großteil vermieden und man griff eher auf Vocal-Sounds zurück.

Im Wassertank vermag man eine Turbine oder einen Jet als Original-Sound zu hören. In Wahrheit kamen hier aber Vocals zum Einsatz, die den Shepard-Tone nachbilden. Dies ist ein Effekt, der vermeintlich endlos ansteigt. Die Wirkung wird dadurch erzielt, dass ein Ton z.B. von C3 bis C5 ansteigt. Allerdings gibt es einen Fade-In von C3 bis C4. Aber C4 bis C5 gibt es wieder einen Fade-Out. Während der erste Sound bei C4 ist, startet der nächste (identische) bei C3 mit einem Fade-In. So gibt es also verschiedene Oktaven, die unterschiedlich laut zu hören sind. Randy Thom nutzte diesen Effekt auch, um in dem Film 'Plain' den Absturz des Flugzeuges nicht in der Dramaturgie abreißen zu lassen.

SoundWorks Collection - The Sound of Flight from Michael Coleman on Vimeo.

Als Mikrofone kamen ein Sennheiser MKH416 und ein Kontakt-Mikrofon zum Einsatz. Etwas Reverb macht den Effekt etwas weicher und indirekter. Zusätzliche wurden einige Stimmen eine Oktave tiefer gestimmt.

Wichtig beim Sound-Konzept war, dass das Geräusch nicht durch eine Turbine erzeugt wird, die das Wasser antreibt, sondern dass das Wasser die Turbine bewegt wie in einem Wasser-Stromwerk.

Von der Wassertank-Szene hörten wir uns nur die Foley-Effekte an. Gerade bei dieser Szene fand eine enge Zusammenarbeit zwischen Foley und FX Editors statt. Die Foley Artists kümmerten sich auch um Wasser-Bewegungen und Bewegungen unter Wasser. Daher landeten viele Foley-Aufnahmen später auf FX Gruppen. Zu 20 Prozent wurden Foley-Aufnahmen gemacht, was wenig ist. Die Wassertank-Szene hätte normalerweise sechs Tage gebraucht, wurde aber in nur drei Tagen fertiggestellt. Die Foleys für den kompletten Film wurde in vier Wochen aufgenommen.

Foleys klingen alleine manchmal recht trocken und direkt, halten aber oft Dialog und FX zusammen. Zusätzlich können Foleys einen Rhythmus reparieren. Durch den Bildschnitt, wenn ein Schauspieler von einem in ein anderes Zimmer geht, könnte der Rhythmus der Schritte ungleichmäßig im O-Ton / Production-Sound sein. Dies kann mit Foley gerettet werden.

Ein weiteres Konzept-Beispiel im Sound-Design war der Arm der Turbine, der sich im Kreis dreht und Tom Cruise im späteren Verlauf erwischt und von seinem Vorhaben abhält. Auch wenn dieser Arm sich konstant bewegt, ist er immer nur dann kurz zu hören, wenn er sich sichtbar vorbei bewegt. Wäre er immer hörbar, könnte man sich fragen, warum Ethan Hunt den Arm nicht selber gehört hat, lange bevor er von ihm getroffen wird, und ausweicht.

Wichtig ist auch der Herz-Sound. Dieser hat zwei Zwecke. Zum Einen unterstreicht er die Dramaturgie. Zum Anderen wird der Herzschlag später immer langsamer und leiser, als Ethan Hunt zu ertrinken droht. Das Herz besteht aus zwei Elementen: Einer gefilterten Kick-Drum und einem Sonographie ähnlichen Sound. Zuerst wurde wirklich ein Original-Sound genommen. Dieser war aber nicht überzeugend. Daher wurden mehrere Wooshes gelayert, mit Hall versehen, gefiltert und geloopt.

Um wirklich auf die tiefen Frequenzen gut spüren zu können, bliesen alle Teilnehmer einen Luftballon auf und nahmen ihn in die Hand. So kann man den Ton noch besser wahrnehmen.

Der Tag wurde beschlossen mit der Aufgabe, die Wassertank-Sequenz selber zu vertonen.

Am zweiten Tag ging es in die Natur. Alle Teilnehmer waren bepackt mit Aufnahme-Equipment. Dabei kam wirklich alles zum Einsatz:

- iPhone mit eingebautem Mikrofon

- Rode-Mikro iXY auf iPhone

- Fostex FR2LE

- SoundDevices 552

- SoundDevices 788T

- Neumann M/S System

- Zoom H4

- Zoom H6

- Neumann KMR 82i

- Rode NT4

- Rode NTG3

https://www.youtube.com/embed/9WI0sdNoId8 Der erste Halt war ein altes Wasser-Kraftwerk. Dort gab es viele Wasser-Geräusche, die aufgenommen wurden. Weiter ging es zum Bahnhof. Dort fanden zuerst ankommende und abfahrend Züge ihren Weg auf die SD-Karte. Ein Teil der Crew betrat (teils ohne Ticket) den Zug, um eine Station zu fahren und die Geräusche innen aufzunehmen. Leider hörte man überall Gespräche, Telefone, Telefon-Gespräche, Kinder und Brot-Tüten. Der andere Teil der Crew blieb vor Ort und nahm an einer Baustelle Geräusche auf.

Auf dem Rückweg nutzte man den nassen Asphalt, der besonders schöne Geräusche macht, wenn Autos vorbeifahren.

Zurück im 'Arbeitsraum' nahmen wir unsere Stimmen auf, um den Shepard-Tone nachzubilden. Anschließend teilten wir uns in eine Wasser- und eine Maschine-Gruppe auf (jeweils vier Teilnehmer). Ich war in der Maschine-Gruppe. Mit den Vocal-Aufnahmen und den Zug Geräuschen baute ich den Shepard-Tone. Aus den Vocal-Aufnahmen mussten die besten Stellen gefunden werden. Dazu kam noch, dass Vocal-Einsätze verschleiert oder weichgezeichnet werden mussten, damit der Effekt flüssig wurde. Auch Atmer wurden entfernt. Für das Anfahren der Turbine wurde ein tiefer Vocal-Sound erzeugt. Dafür wurde der bearbeitete Effekte in 96 kHz abgespeichert und in das Projekte ohne Samplerate-Konvertierung eingeladen. Da das Projekt (wie immer bei Film) mit 48 kHz arbeitete, wurde das File halb so schnell wiedergegeben. Dadurch war es doppelt so lang und eine Oktave tiefer.

Da uns netterweise MacBookPros zur Verfügung gestellt wurden, auf denen ProTools installiert war, mussten wir mit den internen PlugIns arbeiten. Die tiefen Vocals wurden mit dem Sans-Amp und dem Sci-Fi Effekt bearbeitet. Etwas mehr Tiefe bekam der Effekt durch einen Raum. Anschließend gab es zwei Filter. Der Lowpass-Filter wurde immer weiter aufgezogen, um den Sound einzublenden. Der Hochpassfilter ließ den Sound am Schluss verschwinden, statt eines simplen Fade Outs.

Der obere Chor wurde ähnlich bearbeitet. Für etwas mehr Bewegung und um den ansteigenden Effekt zu verstärken, nutze ich im PlugIn Sci-Fi den Res+ Modus und fuhr die Frequenz immer höher. Die Sounds wurden leicht im Panorama verteilt. Eine zu starke Verteilung hätte aber die Wirkung des Shepard-Tones zerstört. Daher wurde ein Delay benutzt, was links und rechts leicht unterschiedliche Delay-Zeiten hatte, was den Sound breiter erscheinen lässt.

https://www.youtube.com/embed/p6rxbV-KRkI

Alex kümmerte sich um weitere Maschinen-Sounds. Einige Zug-Aufnahmen wurden für das Anfahren der Maschine benutzt. Mit anderen wurde auch ein Shepard-Tone ähnlicher Effekt erzeugt. Für mehr Obertöne nutzte Alex den PitchShifter und dessen Feedback, das gerade so hoch eingestellt wurde, dass es nicht wehtut.

Bei anderen Aufnahmen wurde ein Waves Denoiser zweckentfremdet und so stark eingestellt, dass er das Signal verfremdet und zu stark eingreift. Dadurch wird der Sound durch entfernte Transienten weichgezeichnet und bekommt sogar einen leichten Unterwasser-Effekt.

Eine andere Quelle ist eine Schuh-Putz-Maschine. Alex drückte mit dem Fuß so fest dagegen, dass die Maschine stoppte. Als er den Druck reduzierte, fing die Maschine wieder langsam an zu laufen und erhöhte das Tempo. Dabei hörte man auch wunderbar, wie der Motor gegen den Druck des Schuhs arbeitet.

Für den Final-Mix fügten beide Gruppen ihre Arbeit zusammen. Im Vergleich mit James' Arbeit stellte sich heraus, dass in seiner Mischung viel weniger Wasser zu hören ist, was am Anfang bei ihm aber auch nicht so war und das Ergebnis eines langen Prozesses war.

Nach drei Tagen stieg ich inspiriert in den Zug nach Hause. James beantwortet wirklich jede Frage, gibt viel Wissen weiter, was man nicht so einfach bekommt und unterhält dabei gleichzeitig. Gleichzeitig lernt man viele nette Leute / Kollegen kennen. Die ganze Zeit über bestand ein reger Austausch zwischen allen Teilnehmern. Jeder, der nicht bei dieser Masterclass dabei war, hat viel verpasst. Die nächste Möglichkeit ist wieder die MediaSoundHamburg.

Die Teilnehmer der Masterclass stellten netterweise einige Aufnahmen zur Verfügung, die ihr runterladen könnt.

Sounds: Library_Masterclass.zip (ca. 900 MB zip)

Vorherige Artikel zur FilmSound Hamburg auf recording.de

James Mather Masterclass-Sounddesign 2012 (Link)

Randy Thom Masterclass-Sounddesign 2013 (Link)